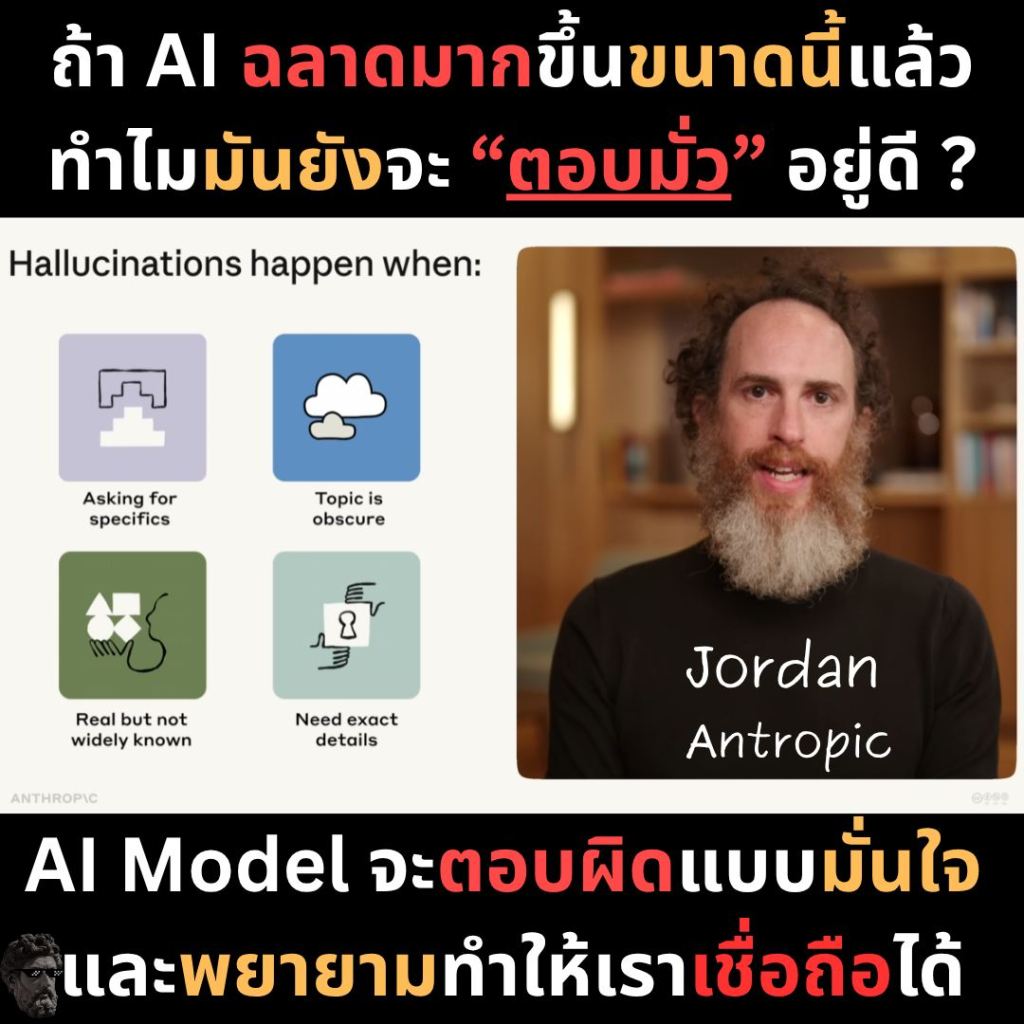

ถ้า AI ฉลาดขึ้นขนาดนี้…แล้วมันยัง “มั่ว” ได้ยังไง?

(คำตอบตรงจากคนที่สร้าง Claude)

.

ช่วงนี้หลายคนเริ่มใช้ AI แบบจริงจังมากขึ้น ทั้งทำงาน เขียน Script หาข้อมูล แล้วจะมี moment หนึ่งที่ทุกคนเจอเหมือนกันคือ

.

“ไอหมอนี้มันมั่วนี้หว่าาา มั่วทั่งแถบเลยย” 55555555

.

และที่น่ากลัวคือ มันพูดด้วยความมั่นใจมากก แบบนิ่งสุดๆ

(แล้วคือจิตวิทยาคนไทยแบบพวกเราแพ้คนมั่นใจมากๆแบบนี้ด้วย)

.

คำถามคือ ถ้า AI advanced ขนาดนี้แล้ว

ทำไมมันยัง hallucinate อยู่?

.

คำตอบนี้ถูกอธิบายโดยทีมของ Anthropic (บริษัทที่สร้าง Claude AI)

และพอเข้าใจ…คุณจะใช้ AI ได้ฉลาดขึ้นทันที

มาฟังเรื่องนี้กัน #อ่านจบปุ๊ปเก่งขึ้นปั๊ป

======================

Part 1 : Hallucination = มั่วแบบมั่นใจ

.

Hallucination คือสภาวะ การที่ AI สร้างข้อมูลที่ไม่จริงขึ้นมา แต่พูดเหมือนเป็นเรื่องจริง

.

มันอาจจะ

– อ้าง paper ที่ไม่มีอยู่จริง

– สร้าง statistic ปลอม

– หรือให้ข้อมูลผิดเกี่ยวกับคนหรือเหตุการณ์จริง

.

ตัวอย่างในคลิปคือ

ถาม Claude เรื่อง paper ของ Jared Kaplan

มันตอบมาเป็นเรื่องเป็นราว

แต่… ไม่มี paper ไหนมีอยู่จริงเลย

——

Part 2 : ทำไมมันถึงเกิดขึ้น?

คำตอบหลักมีแค่นี้เลย

คนส่วนใหญ่ชอบคิดว่า AI ทำงานเหมือน Google คือไปดึงข้อมูลมาตอบ

แต่จริงๆ AI ไม่ได้ “รู้” มันแค่ “เดาว่าคำถัดไปควรเป็นอะไร”

.

มันถูก train จาก text จำนวนมหาศาลบนอินเทอร์เน็ต

แล้วมันเก่งมากในการจับ pattern ว่า

“ประโยคแบบนี้ ปกติควรพูดต่อยังไง”

.

เหมือน autocomplete ในมือถือ แต่ฉลาดกว่ามาก

ปัญหาคือ ถ้าคำถามนั้น “ข้อมูลมีน้อย”

เช่น เรื่อง niche คนไม่ดัง หรือ detail เฉพาะมากๆ

.

AI จะไม่มีข้อมูลพอ แล้วมันจะทำสิ่งนี้แทน

“ลองเดาดูให้มันดูสมเหตุสมผล”

และแน่นอน ไอหมอนี้บางครั้ง…มันก็เดาผิด

————

Part 3 : The Helpfulness Problem

อีกจุดหนึ่งที่สำคัญมาก

AI ถูกฝึกมาให้ “เป็นผู้ช่วยที่ดี”

ซึ่งแปลว่า มัน “อยากตอบคุณให้ได้”

แม้ว่ามันจะไม่แน่ใจ

.

เปรียบเทียบให้เห็นภาพง่ายๆว่า

เหมือนเพื่อนที่อ่านหนังสือมาเยอะมาก และภูมิใจว่าเป็นคนรู้เยอะ

.

แต่พอถามเรื่องที่ไม่รู้จริงๆ เขาจะ “ตอบมั่วแบบมั่นใจ”

แทนที่จะบอกว่า “ไม่รู้”

AI ก็เหมือนกัน

—————

Part 4 : ทำไมมันยิ่งอันตรายขึ้น?

เพราะ hallucination “ดูเหมือนคำตอบที่ถูกทุกอย่าง”

สิ่งที่ยากคือ

– คาดเดายาก

– ตรวจจับยาก

– และคำตอบผิด “หน้าตาเหมือนคำตอบถูก”

.

และที่สำคัญคือ ตอนนี้ AI ดีขึ้นมาก

hallucination น้อยลง แต่พอคนเริ่ม “ไว้ใจมากขึ้น”

คนก็ “เลิกตรวจสอบ”

—–

Part 5 : เขาแก้ปัญหานี้ยังไง?

ฝั่ง Anthropic ทำหลายอย่างมาก

– สอนให้ AI พูดว่า “ไม่รู้” เมื่อไม่มั่นใจ

– ฝึกให้ความซื่อสัตย์ = สิ่งที่ดีมี

– ยิงคำถามยากๆ หลายพันข้อเพื่อ test

– วัดว่า AI หลอกมั้ย / hedge ดีมั้ย / มั่นใจเกินไปมั้ย

.

แต่ทางทีม Antropic เขายอมรับตรงๆ ว่า

นี่ยัง “ไม่ใช่ปัญหาที่แก้ได้แล้ว”

แต่เป็นยังเป็น Challege ของทั้งวงการ AI ที่ต้องแก้ต่อไปเรื่อยๆ

——

Part 6 : วิธีจับ hallucination (สำคัญมาก)

ทีม Antropic เขาให้ guideline มาแบบง่ายๆเลย

Hallucination จะเกิดบ่อยเมื่อ

– ตอนคุณถาม fact เป๊ะๆ

– เรื่อง niche หรือใหม่มาก

– คนหรือสถานที่ที่ไม่ดัง

– หรือข้อมูลที่ต้องละเอียด เช่น วันที่ ตัวเลข ชื่อ

.

วิธีรับมือคือ

– ขอให้ AI “ใส่ source”

– ให้มัน “เช็ค source เองอีกที”

– บอกมันตรงๆ ว่า “ไม่รู้ได้”

– ถามมันว่า “มั่นใจแค่ไหน”

– เปิด chat ใหม่ให้มัน “ตรวจคำตอบตัวเอง”

– และถ้าเรื่องสำคัญ → cross-check เสมอ

===============

ถ้าคุณชอบบทความแนวนี้ แล้วไม่อยากพลาด สามารถใส่ Email ของคุณได้ที่ Link นี้เลย (ฟรีไม่มีค่าใช้จ่าย)

AI ไม่ได้ตั้งใจมั่ว

แต่มันถูกออกแบบมาให้ “ตอบให้ได้…แม้จะไม่แน่ใจ”

.

Hallucination เลยไม่ใช่ bug แปลกๆ

แต่มันคือ “ผลลัพธ์ของระบบที่เก่งในการเดา…แต่ไม่ได้รู้จริง”

.

แต่ถ้าเราให้ AI ช่วย Check บ่อยๆ ระวัง Token คุณจะหมดไม่รุ้ตัว

Skill ที่เรายังต้องไปกันต่อคือ Skill Prompt ยิ่งเราใช้มันละเอียดมากเท่าไหร่ มันยิ่งพัฒนาระบบให้เราประหยัด Token ได้มากขึ้นเท่านั้น

.

คำถามในยุคนี้ไม่ใช่ AI ฉลาดพอไหม?

แต่คือ คุณรู้ไหมว่า “เมื่อไหร่ที่มันเริ่มเดา”

และถ้าคุณจับจุดนั้นได้

AI จะไม่ใช่เครื่องมือที่หลอกคุณ

แต่จะกลายเป็นเครื่องมือที่ “ช่วยให้ทำงานได้เร็วขึ้นแบบมหาศาล”

.

ผมหวังว่าเรื่องนี้จะช่วยสร้างวันของคุณ

ใส่ความเห็น